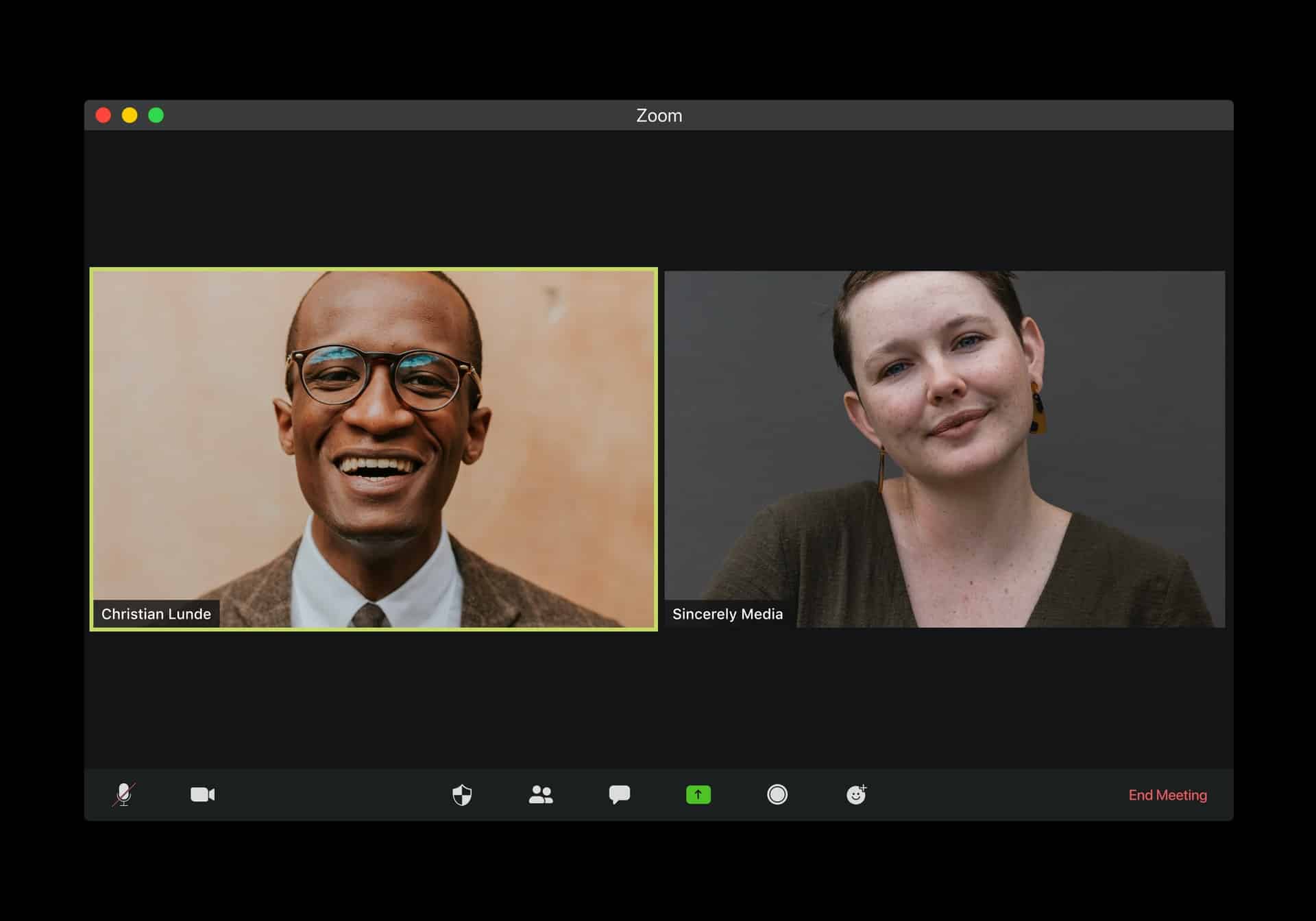

Πριν μερικούς μήνες, το Zoom είχε κοινοποιήσει τα σχέδια του για πιθανή ενσωμάτωση τεχνητής νοημοσύνης στο λογισμικό εικονικών συναντήσεων, το οποίο θα ανιχνεύει και θα αναλύει τη διάθεση και τα συναισθήματα των ανθρώπων. Τώρα, περισσότερες από 25 οργανώσεις ανθρωπίνων και ψηφιακών δικαιωμάτων έστειλαν επιστολή στη Zoom απαιτώντας να ακυρώσει τα σχέδια για ενσωμάτωση χαρακτηριστικών τεχνητής νοημοσύνης που αναγνωρίζει το συναίσθημα στο λογισμικό συνεδριάσεων.

O τεχνολογικός γίγαντας Intel συνεργάζεται με μια εταιρεία λογισμικού μηχανικής μάθησης για την παραγωγή ενός προγράμματος ανάλυσης συναισθημάτων που είναι ανάλογο με το Zoom. Αυτό το πρόγραμμα προορίζεται για να βοηθήσει τους εκπαιδευτικούς λέγοντάς τους πότε οι μαθητές φαίνονται μπερδεμένοι ή βαριεστημένοι, επιτρέποντάς τους να προσαρμόσουν τη διδασκαλία τους και να αυξήσουν τη δέσμευση. Το Protocol ανέφερε ομοίως τον Απρίλιο ότι οι εταιρείες έχουν αρχίσει να χρησιμοποιούν την τεχνητή νοημοσύνη συναισθημάτων κατά τη διάρκεια τηλεφωνικών κλήσεων πωλήσεων για να αξιολογούν τις διαθέσεις των δυνητικών πελατών και να προσαρμόζουν ανάλογα τη στρατηγική τους. Χωρίς να το γνωρίζει, κάθε πελάτης βαθμολογείται σε μια “κάρτα βαθμολογίας συναισθημάτων” καθ’ όλη τη διάρκεια της κλήσης.

Το Zoom είναι ίσως η πιο μεγάλη πλατφόρμα βιντεο-συνεδριάσεων και είναι γεγονός ότι ασκεί μεγάλη επιρροή και οδηγεί τις εξελίξεις στον κλάδο. Γι’ αυτό οι ομάδες πολιτικών δικαιωμάτων κινητοποιούνται έντονα για να εμποδίσουν τα σχέδιά του, καθώς θεωρούν ότι το λογισμικό αυτό θα οδηγήσει σε χειραγώγηση και ότι μπορεί να αποδειχθεί δυνητικά επικίνδυνο, καθώς θα βασίζεται σε υποθέσεις ότι όλοι οι άνθρωποι χρησιμοποιούν τις ίδιες εκφράσεις προσώπου, μοτίβα φωνής και γλώσσα του σώματος για το κάθε συναίσθημα και διάθεση, κάτι που δεν ισχύει.

Διαβάστε επίσης: Πώς οι αλγόριθμοι Τεχνητής Νοημοσύνης μπορούν να επηρεάσουν τις ανθρώπινες σχέσεις

Πως λειτουργεί η συναισθηματική τεχνητή νοημοσύνη

Η τεχνητή νοημοσύνη συναισθημάτων χρησιμοποιεί την όραση υπολογιστών για την αναγνώριση προσώπου, την αναγνώριση ομιλίας, την επεξεργασία φυσικής γλώσσας και άλλες τεχνολογίες ΑΙ. Η υπολογιστική όραση είναι ίσως η πιο διαδεδομένη μέθοδος αναγνώρισης συναισθημάτων, με την παρακολούθηση των ορόσημων του προσώπου, επιτρέποντάς της να διακρίνει μεταξύ ενός χαμόγελου και ενός συνοφρυωμένου προσώπου. Με αυτόν τον τρόπο συλλέγει δεδομένα που σχετίζονται με τις εκφράσεις του προσώπου των ανθρώπων προσπαθώντας να ανιχνεύσει τα εσωτερικά τους συναισθήματα, τις στάσεις ή τη διάθεση τους.

Η επεξεργασία φυσικής γλώσσας είναι ένα άλλο δημοφιλές όπλο της συναισθηματικής πληροφορικής. Οι λέξεις που χρησιμοποιούμε μπορούν να προβλέψουν τη συναισθηματική μας κατάσταση. Ωστόσο, ο τόνος, ο ρυθμός και ο επιτονισμός είναι που βοηθούν να διαχωρίσουμε το αληθινό συναίσθημα από πιο διφορούμενες διατυπώσεις, όπως για παράδειγμα ο σαρκασμός.

Εργαλεία βασισμένα στην τεχνητή νοημοσύνη για την αξιολόγηση της συναισθηματικής κατάστασης των ανθρώπων χρησιμοποιούνται συνήθως σε πλατφόρμες εικονικής τάξης και σε τεχνολογίες για οχήματα για την ανίχνευση της απόσπασης της προσοχής των οδηγών, των σημείων μέθης και της οργής στο δρόμο. Οι εταιρείες που παράγουν συνθετικές εικόνες και δεδομένα βίντεο παρέχουν την πρώτη ύλη, που χρησιμοποιείται για την εκπαίδευση της AI συναισθημάτων και συναφών συστημάτων, αλλά μερικές φορές οι εταιρείες αυτές απομακρύνονται από τις τελικές χρήσεις των δεδομένων που παρέχουν.

Διαβάστε επίσης: Τι ειναι η «Τεχνολογία της Ευτυχίας» και γιατί θα απασχολήσει τις μεγάλες εταιρείες

Το πρόβλημα με την συναισθηματική τεχνητή νοημοσύνη

Το λογισμικό αυτό του Zoom ουσιαστικά βασίζεται στη θεωρία της ανάλυσης συναισθημάτων. Ωστόσο, η εγκυρότητα της τεχνητής νοημοσύνης συναισθημάτων έχει αμφισβητηθεί και συχνά εγείρει ηθικές ανησυχίες. Όπως συμφωνούν οι ειδικοί, αυτή αποτελεί μια ψευδοεπιστήμη και δε θεωρείται ότι λειτουργεί. Οι εκφράσεις του προσώπου μπορεί να ποικίλλουν σημαντικά από άνθρωπο σε άνθρωπο και συχνά είναι αποσυνδεδεμένες από τα συναισθήματα που κρύβονται από κάτω.

Πράγματι, ορισμένες έρευνες δείχνουν ότι οι τρόποι με τους οποίους οι άνθρωποι εκφράζουν συναισθήματα όπως η ευτυχία, ο θυμός ή η έκπληξη διαφέρουν μεταξύ πολιτισμών και καταστάσεων. Συνεπώς, αυτό που οι άλλοι μπορεί να ερμηνεύσουν από τις εκφράσεις του προσώπου κάποιου μπορεί να είναι διαφορετικό από αυτό που πραγματικά αισθάνεται το άτομο. Μάλιστα, τα μη νευροτυπικά άτομα, όπως για παράδειγμα τα άτομα με αυτισμό, μπορεί να εκφράζουν συναισθήματα με τρόπους που μπορεί να ερμηνευθούν ανακριβώς από άλλους ανθρώπους ή από την τεχνητή νοημοσύνη συναισθημάτων.

Στο μεταξύ, το 2019, το Ινστιτούτο AI Now ζήτησε την απαγόρευση της χρήσης της συναισθηματικής τεχνητής νοημοσύνης σε σημαντικές αποφάσεις όπως οι προσλήψεις και κατά την αξιολόγηση των επιδόσεων των μαθητών. Το 2021, το Ινστιτούτο Brookings ζήτησε να απαγορευτεί η χρήση της από τις αρχές επιβολής του νόμου.

Η χρήση της ΑΙ που ανιχνεύει το συναίσθημα είναι ένα ζήτημα πολύ αμφιλεγόμενο και εγείρει πολλά ηθικά ζητήματα. Η τεχνολογία αυτή ενδεχομένως παραείναι παρεμβατική και συνιστά υπερβολική επιτήρηση, ειδικά όταν τα άτομα που στοχεύονται δε γνωρίζουν ότι αξιολογείται η γλώσσα του σώματος, ο τόνος και άλλοι συναισθηματικοί δείκτες τους. Πολλοί θα συμφωνήσουν ότι τουλάχιστον ο ψυχικός κόσμος και τα συναισθήματα του καθενός είναι ένας τομέας αρκετά προσωπικός και το καλύτερο θα ήταν να παραμείνει έτσι.

Με πληροφορίες από το Protocol

ή αποκτήστε ετήσια συνδρομή εδώ.