Πώς θα σας φαινόταν να μαθαίνατε μια ξένη γλώσσα μέσα από ιντερνετικά μαθήματα, και ο δάσκαλός σας να ήταν άβαταρ που μοιάζει σχεδόν σαν αληθινός άνθρωπος; Ή ο άνθρωπος που σας μιλά με ευγένεια και επαγγελματισμό στην οθόνη, εκπρόσωπος της εξυπηρέτησης πελατών μιας εταιρείας, να είναι επίσης ένα εκπληκτικά ανθρώπινο άβαταρ, σε βαθμό που να μην είστε σίγουροι αν αυτό που βλέπετε είναι ένας αληθινός άνθρωπος ή όχι; Ακόμα και μια επαγγελματική παρουσίαση θα μπορούσε να πραγματοποιηθεί από ένα τέτοιο άβαταρ, εξοικονομώντας πολύ χρονο και χωρίς να χάνεται η αίσθηση της ανθρώπινης επαφής.

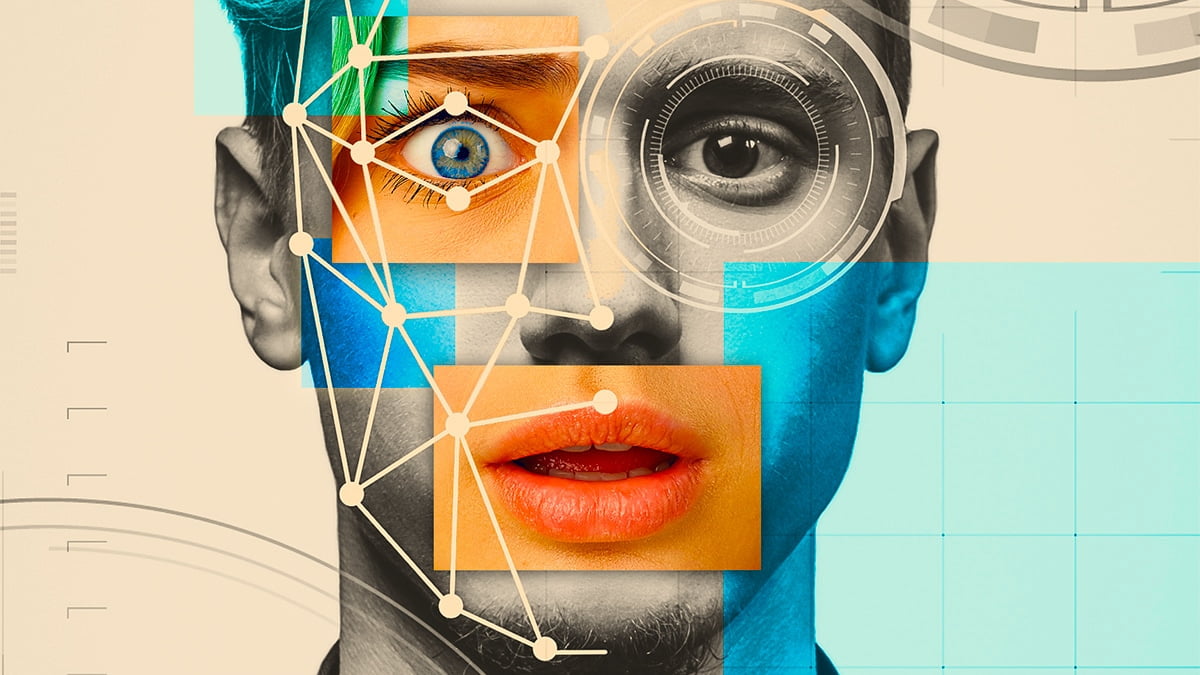

Αυτό υποστηρίζουν τουλάχιστον οι νέες εταιρείες που επνεδύουν σε αυτήν την τεχνολογία, την αναπτύσουν και πωλούν αυτές τις διαφορετικές ιντερνετικές αλλά «ανθρώπινες» προσωπικότητες. Πρόκειται για deepfakes, για ανθρώπους που μοιάζουν αληθινοί, μόνο που δεν είναι: ζουν στο cloud και είναι δημιουργημένοι από αλγορίθμους με βάση αληθινά πρόσωπα και φωνές.

Όλα ξεκίνησαν το 2017. Τότε εμφανίστηκαν τα πρώτα deepfake βίντεο, που πήραν το όνομά τους από έναν ανώνυμο χρήστη του Reddit με το ψευδώνυμο Deepfakes, που δημιουργούσε τέτοιες εικόνες συνθετικών media που μοιάζουν απολύτως αληθινές, μόνο που δεν είναι. Για παράδειγμα, το 2019 κυκλοφόρησε ένα deepfake βίντεο που έδειχνε τον Nixon να αποτίει φόρο τιμής στους αστροναύτες Buzz Aldrin και Neil Armstrong που σκοτώθηκαν στην αποστολή Apollo 11 στο φεγγάρι – σε ένα υποθετικό σύμπαν. Ο Barack Obama και ο Putin επίσης έχουν εμφανιστεί να λένε πράγματα που ποτέ δεν ξεστόμισαν, σε deepfake βίντεο με τη μορφή τους, που δικαιολογούν όσους φοβούνται ότι αυτή η τεχνολογία συνοδεύεται από μια πληθώρα κινδύνων απειλητικών για τη δημοκρατία και την αλήθεια.

Από την άλλη, φέτος είδαμε (ή καλύτερα, ακούσαμε) τον εκλιπόντα Anthony Bourdain να μιλά σε ένα ντοκιμαντέρ που γυρίστηκε για τη ζωή του, μετά την αυτοκτονία του, χάρη σε αυτήν την τεχνολογία, που όμως ήδη ανησυχεί τους ηθοποιούς φωνής. Επίσης φέτος, ένας ηθοποιός μήνυσε το TikTok για τη χρήση της φωνής του χωρίς τη συναίνεσή του στο εργαλείο του που μετατρέπει κείμενο σε ομιλία.

Η αλήθεια είναι ότι πρόκειται για μια τεχνολογία άκρως δελεαστική για χρήση σε κάθε είδους επιχειρηματική δραστηριότητα, που ωστόσο η διάδοσή της προχωρά με αλματώδεις ρυθμούς, κάτω από τη μύτη όλων – όπως ακριβώς ξεκίνησε: τα πρώτα βίντεο deepfake ήταν πορνογραφικά. Δημιουργήθηκαν το 2017, όταν χρήστες του Reddit δημιούργησαν και κυκλοφόρησαν βίντεο με τα πρόσωπα από γυναίκες celebrities σε σώματα πορνοστάρ. Αν και το Reddit απαγόρευσε τη δημοσίευση τέτοιων βίντεο το 2018, έχουν εμφανιστεί έκτοτε πολλά άλλα websites και εφαρμογές όπου κυκλοφορούν ανάλογες deepfake δημουργίες. Τα στοιχεία δείχνουν ότι ο αριθμός των κάθε είδους deepfake βίντεο που κυκλοφορούν στο ίνερνετ διπλασιάζεται κάθε σχεδόν κάθε έξι μήνες, με τα βίντεο μη συναινετικού πορνογραφικού περιεχομένου, αποκλειστικά με γυναίκες, να κυριαρχούν, αν και τα μέσα, καλύπτοντας το θέμα, ανησυχούν περισσότερο για τις πολιτικές προεκτάσεις που μπορούν να έχουν τέτοια απολύτως ρεαλιστικά βίντεο που όμως μεταφέρουν και απολύτως ψευδείς πληροφορίες.

Δείτε ακόμα: το μέλλον των stock φωτογραφιών ανήκει στα 3D μοντέλα;

Υπάρχουν ωστόσο εταιρείες που δημιουργούν τέτοια βίντεο με «αληθινά» άβαταρ για να καλύψουν τις νέες επιχειρηματικές ανάγκες, σημειώνοντας ότι προσέχουν να λαμβάνουν υπόψη τους τον ανθρώπινο παράγοντα, και ότι απλώς εξυπηρετούν τις νέες ανάγκες για συνθετικά media που δημιούργησε στις εταιρείες η ανάπτυξη του metaverse, της τενολογίας του blockchain, των νέων μοντέλων της εξ αποστάσεως εργασίας. Τα deepfake βίντεο είναι, όπως λένε, η λύση, τώρα που η φυσική παρουσία σε ένα στούντιο γυρισμάτων είναι πιο δύσκολη.

Έτσι, μπορεί μια εταιρεία να αγοράσει deepfake δασκάλους ξένων γλωσσών, που ίσως κοστίζουν λιγότερο, διατηρώντας, όσο είναι εφικτό, τη σημασία που παίζει ο ανθρώπινος παράγοντας στη διδασκαλία. Ή μια επιχείρηση να έχει deepfake ρεσεψιονίστ που υποδέχονται τους πελάτες της στη γλώσσα τους. Υπάρχει ακόμα ένα γερμανικό κανάλι που «προσέλαβε» τέτοια άβαταρ για να μεταδίδουν το σκορ ποδοσφαιρικών αγώνων. Tις δυνατότητες ενός deepfake μπορεί να εκμεταλλευτεί ακόμα ένας YouTuber που δεν τα πάει καλά με την κάμερα, αλλά δε θέλει να χάσει το ανθρώπιο στοιχείο με ένα animation, για παράδειγμα – ή και κάποιος που θέλει να δημιουργήσει ένα podcast.

Οι δημιουργοί των άβαταρ αυτών σπεύδουν να εξηγήσουν ότι οι χαρακτήρες που πωλούν, τα πρόσωπά τους δηλαδή, είναι βασισμένα σε αληθινούς ανθρώπους, που ωστόσο αμείβονται κάθε φορά που το πρόσωπό τους χρησιμοποιείται. Χρειάζεται μόλις μισή ώρα για να βιντεοσκοπηθεί με κάμερα υψηλής ανάλυσης ένα πρόσωπο ώστε να χρησιμποιηθεί σε ένα deepfake. Aυτό που απαιτεί περισσότερο χρόνο είναι η ηχογράφηση της φωνής.

Δείτε ακόμα: Διαφημίσεις όταν ονειρευόμαστε: το νέο όπλο των διαφημιστών

Κάποιες εταιρείες χρησιμοποιούν μια ειδική διακριτική σήμανση που διευκρινίζει ότι πρόκειται για ένα συνθετικό βίντεο και λένε ότι δεν πωλούν τα προϊόντα τους για αμφιλεγόμενος σκοπούς. Ωστόσο, κάποιοι ειδικοί καλούν τα κράτη να καθορίσουν εγκαίρως ένα ρυθμιστικό πλαίσιο για τη δημιουργία και τη χρήση των deepfakes. Εξάλλου, η τεχνολογία προχωρά αλματωδώς και, καθώς οι επεξεργαστές και τα GANs ή Generative Adversarial Networks (Παραγωγικά Αντιπαραθετικά Δίκτυα) μηχανικής μάθησης εξελίσσονται καθιστώντας δυνατή τη γρηγορότερη και καλύτερη σημιουργία deepfake βίντεο, αυτά θα γίνονται όλο και πιο δημοφιλή αλλά και πιο πειστικά.

Επιλέον, πιστεύεται ότι τα βίντεο αυτά θα συνεχίσουν να διαδίδονται και να χρησιμοποιούνται σε μια ευρεία γκάμα εφαρμογών, καθώς τα φωτο-ρεαλιστικά ανθρώπινα πρόσωπα έχουν έναν διαφορετικό αντίκτυπο στην ανθρώπινη ψυχολογία – είναι σαν να δημιουργούν μια αληθινή ανθρώπινη σύνδεση. Αυτό προσπαθούν να κάνουν τουλάχιστον οι εταιρείες που τα δημιουργούν, να μοιάζουν όσο γίνεται περισσότερο με αληθινούς ανθρώπους. Από την άλλη, κάποιοι σημειώνουν ότι τα πρόσωπα αυτά ασκούν μία σκοτεινή γοητεία: είναι περίεργο να έχει απέναντί του κάποιος ένα πρόσωπο που το νιώθει αληθινό, καθώς βασίζεται μάλιστα σε έναν πραγματικό άνθρωπο, αλλά την ίδια στιγμή ξέρει ότι είναι καθαρά συνθετικό.

Καθώς αναπτύσσεται η σχετική τεχνολογία και δημιουργούνται νέες δυνατότητες, θεωρείται βέβαιο ότι ολοένα και περισσότερες επιχειρήσεις θα στρέφονται σε αυτό το νέο μέσο, που αναμένεται να ανοίξει ένα καινούριο, ενδιαφέρον και αμφιλεγόμενο πεδίο δράσης και για το marketing – ένα πεδίο όπου τα όρια μεταξύ αληθινού και ψεύτικου γίνονται όλο και πιο ασαφή.

ή αποκτήστε ετήσια συνδρομή εδώ.